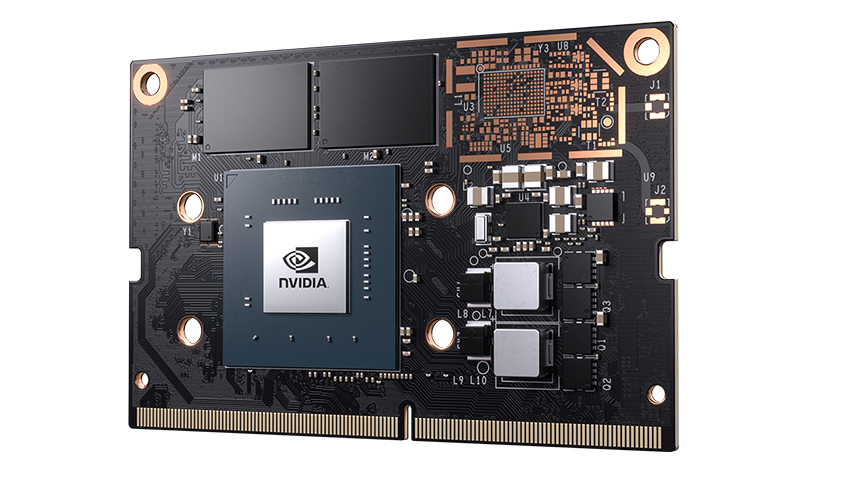

Les modules Jetson TX2 et Jetson AGX Xavier de Nvidia, conçus respectivement pour les applications d’intelligence artificielle (IA) en périphérie de réseau (edge) et les machines intégralement autonomes, ont désormais un petit frère. ...Aux dimensions de 70 x 45 mm, le Jetson Nano n’en développe pas moins une performance de 472 Gflops suffisante pour exécuter des tâches IA dignes de ce nom, et ce dans une enveloppe thermique qui n’excède pas 5 watts, précise Nvidia. Des caractéristiques qui, selon la société, peuvent intéresser 30 millions de makers, développeurs, inventeurs et étudiants, d’autant que le Jetson Nano est proposé en deux versions, l’une adaptée aux développeurs, makers et autres amateurs éclairés (facturée à 99 dollars) et l’autre conçue pour une utilisation dans des productions de volume (commercialisée à 129 dollars).

Dans le détail, le module est bâti sur une puce-système intégrant un quadruple cœur Arm Cortex-A57 et une unité graphique Maxwell à 128 cœurs Nvidia Cuda avec capacité d’encodage/décodage vidéo 4K. On y trouve aussi 4 Go de mémoire LPDDR4 64 bits, une mémoire de stockage eMMC 5.1 de 16 Go, des interfaces pour caméras et afficheurs (Mipi CSI-2, HDMI 2.0 ou DP 1.2/eDP 1.4/DSI), un lien Gigabit Ethernet et tout un jeu d’interfaces d’entrées/sorties (PCIe, USB 3.0, USB 2.0, SDIO, SPI, I2C, I2S, GPIO…).

Dans le détail, le module est bâti sur une puce-système intégrant un quadruple cœur Arm Cortex-A57 et une unité graphique Maxwell à 128 cœurs Nvidia Cuda avec capacité d’encodage/décodage vidéo 4K. On y trouve aussi 4 Go de mémoire LPDDR4 64 bits, une mémoire de stockage eMMC 5.1 de 16 Go, des interfaces pour caméras et afficheurs (Mipi CSI-2, HDMI 2.0 ou DP 1.2/eDP 1.4/DSI), un lien Gigabit Ethernet et tout un jeu d’interfaces d’entrées/sorties (PCIe, USB 3.0, USB 2.0, SDIO, SPI, I2C, I2S, GPIO…).

Côté logiciels, le module prend en charge le kit de développement JetPack qui intègre les bibliothèques d’accélération Nvidia Cuda-X ainsi qu’une pile IA complète avec bibliothèques pour l’apprentissage machine, la vision artificielle, les calculs graphiques et le traitement multimédia, précise Nvidia. JetPack dispose en outre d'un système d’exploitation Linux et des dernières versions en date des logiciels Cuda, cuDNN et TensorRT.

Facturé 99 dollars et disponible dès aujourd’hui, le Jetson Nano Developer Kit associe au module Jetson Nano une carte porteuse équipée de divers connecteurs donnant accès direct aux signaux de la plate-forme. Commercialisé 129 dollars pour des quantités minimales de 1 000 pièces, le module Jetson Nano pour productions de volume sera disponible, quant à lui, à partir du mois de juin.

A noter que Nvidia a collaboré avec Amazon Web Services pour qualifier la plate-forme AWS IoT Greengrass afin que cette dernière tourne de façon optimale sur les produits Jetson tels que le Jetson Nano. Ainsi les modèles d’apprentissage automatique peuvent être créés, entraînés et optimisés dans le cloud AWS puis déployés sur des équipements de périphérie de réseau hébergeant AWS IoT Greengrass.

Vous pouvez aussi suivre nos actualités sur la vitrine LinkedIN de L'Embarqué consacrée à l’intelligence artificielle dans l’embarqué : Embedded-IA https://www.linkedin.com/showcase/embedded-ia/

-fr.jpg)