[APPLICATION SYNAPTICS] En matière d'intelligence artificielle (IA), le choix de l'approche la plus rentable dépend des ressources informatiques disponibles qui varient d'une application à l'autre. Plus l’on dispose de ressources, plus l’on a de facteurs à optimiser pour trouver le meilleur compromis entre taille, poids et consommation énergétique (size, weight, and power, SWaP). Dans les cas où les ressources sont très limitées, comme l'IA en périphérie de réseau (Edge AI), les calculs SWaP font du traitement IA-natif le choix qui s'impose. Explications de Synaptics.

Auteur : Neeta Shenoy Vice President

Auteur : Neeta Shenoy Vice President

Corporate Marketing

Synaptics

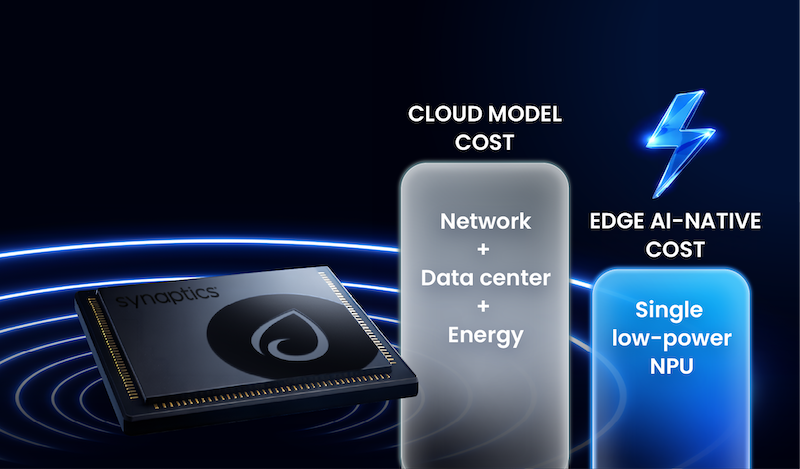

A l'origine, seuls les centres de données étaient capables de traiter des charges de travail liées à l'IA. Aujourd'hui encore, de nombreuses applications d'IA en périphérie (voire la plupart) en dépendent. La communication avec les centres de données distants engendre des coûts liés au réseau et aux centres de données, introduit une latence et augmente la consommation d'énergie. Une situation qui rend cette solution peu pratique pour la nouvelle génération de produits d'IA embarqués sans fil, souvent alimentés par batterie, dont beaucoup doivent réagir en temps réel, ou presque.

Toutefois, si le traitement de l'IA est effectué localement – dans le dispositif IoT ou en périphérie – la latence réseau peut être éliminée (ou du moins considérablement réduite), la consommation énergétique peut être diminuée et des économies peuvent être réalisées.

Cela dit, l'utilisation de processeurs graphiques (GPU) très gourmands en énergie est rarement rentable pour les applications IoT et d'IA en périphérie. Dans la plupart des cas, le recours à des processeurs IA-natifs pour le traitement local reste la seule solution pratique. Les systèmes IA-natifs imitent les méthodes de traitement de l'information les plus efficaces du cerveau humain.

Ces processeurs destinés à l’IA ont également l'avantage de consommer beaucoup moins d'énergie que les GPU ou les CPU, et peuvent être utilisés à moindre coût.

Apprentissage, inférence et GPU… en natif

Le développement de l'IA comporte deux étapes distinctes : l'apprentissage et l'inférence. L'apprentissage consiste à préparer l'IA à effectuer des tâches, tandis que l'inférence est le fait de les réaliser.

L'apprentissage nécessite d'importantes ressources de calcul, et implique de nombreuses opérations itératives sur d'énormes ensembles de données. Auparavant, cet apprentissage nécessitait d'être effectué dans des centres de données disposant de ressources informatiques suffisantes. Cependant, il est de plus en plus faisable d'exécuter des charges de travail d'inférence en dehors des centres de données grâce au traitement IA-natif.

L'entraînement de l'IA partage de nombreuses similitudes avec le traitement graphique. L'adoption des processeurs graphiques (GPU) pour cette tâche s'est donc imposée naturellement. Bien que les GPU soient généralement disponibles à un coût acceptable, leur consommation d'énergie représente un inconvénient qui ne fera que s'accentuer avec les futures générations de GPU. Les processeurs graphiques sont les moins adaptés à l'inférence. Malgré cela, ils restent largement utilisés à cette fin.

De leur côte, les charges de travail liées à l'inférence présentent des niveaux de complexité variables. Les assistants intelligents tels que Siri, Alexa et Google Assistant sont capables de traiter un large éventail de requêtes en langage naturel, mais ce processus s'avère extrêmement complexe.

Bien que ces assistants d'IA soient accessibles sur de plus en plus d'appareils électroniques grand public, la plupart de ces devices ne disposent pas des capacités de calcul nécessaires pour traiter ces requêtes de manière autonome. Par conséquent, les requêtes adressées à ces assistants sont généralement acheminées vers des centres de données, où les charges de travail d'inférence reposent sur les modèles de langage à grande échelle (large language models, LLM) les plus sophistiqués.

Ces LLM nécessitent toujours la puissance de calcul d'un centre de données pour fonctionner efficacement.

Aller vers une “vraie” IA en périphérie

Les entreprises lancent de nouveaux produits qui définissent une périphérie de plus en plus éloignée du cœur du réseau (et des centres de données). Ces dispositifs sont souvent soumis à des contraintes de taille, de poids et de consommation (SWaP) et de budget, ce qui rend difficile la justification de ressources informatiques et énergétiques allant au-delà du strict minimum. Cela semblerait exclure l'IA. En fait, c'était bien le cas au départ.

Cependant, les experts en IA continuent de développer de nouvelles technologies et techniques pour rendre plus viable l'exécution de charges de travail d'inférence modestes dans ces limites. Les développeurs d'appareils périphériques, désireux d'améliorer leurs produits grâce à des capacités basées sur l'IA et/ou d'introduire des fonctionnalités entièrement nouvelles, sont naturellement enclins à adopter cette technologie.

Les GPU et les CPU ne sont pas rentables sur ce marché

Les GPU et les CPU ne sont pas rentables sur ce marché

Les microcontrôleurs, bien que plus petits et plus économes en énergie, sont capables d'exécuter des charges de travail d'inférence, mais ne sont pas non plus la solution idéale pour ce genre de tâches.

La solution la plus adaptée réside dans les processeurs IA-natifs à ultrabasse consommation et conçus spécifiquement pour l'IA. Des systèmes conçus pour l'IA Le développement des réseaux neuronaux a été l'une des premières manifestations électroniques de l'IA.

Les dispositifs neuronaux sont des semi-conducteurs qui imitent la structure des neurones et des synapses du cerveau humain et fonctionnent de manière similaire. Cela confère aux unités de traitement neuronal (neural processing units, NPU) certains avantages intrinsèques similaires. Le cerveau effectue des calculs complexes avec une consommation équivalente à seulement 20 watts.

Les logiciels d'IA doivent être optimisés pour tirer parti des caractéristiques uniques des NPU, mais en combinaison avec un logiciel dédié capable de réaliser des traitements similaires tout en consommant une quantité d'énergie infime.

Les réseaux neuronaux et l'IA étaient autrefois presque entièrement synonymes, mais ce n'est plus le cas, ce qui a engendré une certaine confusion. Les processeurs numériques (CPU, GPU, MCU, DSP, etc.) sont des machines de von Neumann. La caractéristique de l'architecture de von Neumann qui nous intéresse ici est la séparation de la logique et de la mémoire.

Les charges de travail d'IA impliquent naturellement des transferts de données incessants et énergivores entre les données et la logique. La structure des NPU, quant à elle, intègre essentiellement ce que l'on qualifierait, en électronique numérique, de circuits logiques et de mémoire. Les transferts de données sont considérablement réduits, ce qui diminue aussi la consommation d'énergie.

Ainsi, même si les processeurs numériques peuvent être utilisés pour l'IA et constituent parfois le choix le plus approprié (par exemple, les GPU dans les centres de données), la conception d'un processeur Edge AI autour d'un cœur NPU IA-natif sera presque toujours optimale pour les applications d'IA de périphérie aux ressources limitées, telles que les objets connectés situés en périphérie du réseau.

Le cœur NPU d'un processeur Edge AI peut gérer les charges de travail d'IA, telles que l'apprentissage automatique (ML), laissant le cœur MCU ou CPU exécuter le système d'exploitation (OS) et toutes les autres tâches non liées à l'IA.

Économiser l'énergie et ajouter des fonctionnalités, un plus

Un principe fondamental est que chaque système et sous-système d'un périphérique Edge ne doit consommer de l'énergie qu'en cas d'absolue nécessité.

L'IA joue un rôle crucial dans l'évaluation des déclencheurs justifiant la sortie de veille du reste du système. Par exemple, l'IA pourrait faire la différence entre les pleurs d'un bébé et le chant d'un oiseau, permettant ainsi à un moniteur de décider s'il doit s'allumer et déclencher une alarme ou rester en mode veille pour économiser l'énergie.

De même, l'IA peut évaluer si la glycémie d'une personne est restée suffisamment basse pendant une durée suffisante pour qu'un dispositif médical portable destiné aux diabétiques doive se réveiller et s'administrer une dose d'insuline. Une fois l'appareil réveillé, l'IA démontre à nouveau sa valeur en tant que technique d'analyse de données, fournissant des résultats qui peuvent être utilisés pour améliorer les performances et l'efficacité ou en mettant à disposition des informations permettant aux utilisateurs finaux d'agir.

L'IA en périphérie (Edge AI), une priorité

L'Internet des objets (IoT) connaît une croissance rapide et le marché en expansion du traitement de l'IA en périphérie attire l'attention de nombreux fabricants de semi-conducteurs. Dans un marché déjà saturé, plusieurs éléments sont à prendre en compte en priorité.

- Disponibilité du traitement véritablement IA-natif. Un traitement IA‑natif intégré offre aux concepteurs une flexibilité maximale pour trouver le juste équilibre entre la puissance de traitement, la taille, le poids, la dissipation thermique, la consommation d’énergie et la prise en charge du fonctionnement multimodal (par exemple, la combinaison de plusieurs entrées de capteurs).

Les besoins des différents dispositifs IoT. Ceux-ci peuvent varier considérablement : si le traitement IA-natif est primordial, les différents dispositifs d’IA en périphérie nécessiteront l’intégration de différentes combinaisons de cœurs (CPU, GPU, microcontrôleurs) pour diverses applications, provenant de fournisseurs de confiance.

Sécurité évolutive en périphérie. Les mesures de sécurité doivent être conçues pour évoluer avec les futures générations de produits et ne doivent pas être repensées à chaque nouvel appareil ou génération d’appareils.

Une gamme d’entrées/sorties. Il est également essentiel de garantir l’accès à la gamme d’E/S nécessaire pour prendre en charge toutes les entrées de capteurs intégrées aux produits.

L’écosystème de l’IA. Enfin, et c’est peut-être le plus important, Synaptics estime que les entreprises IoT bénéficieront d’un écosystème de fournisseurs proposant un large choix de logiciels d’application, de modèles, et bien plus encore.

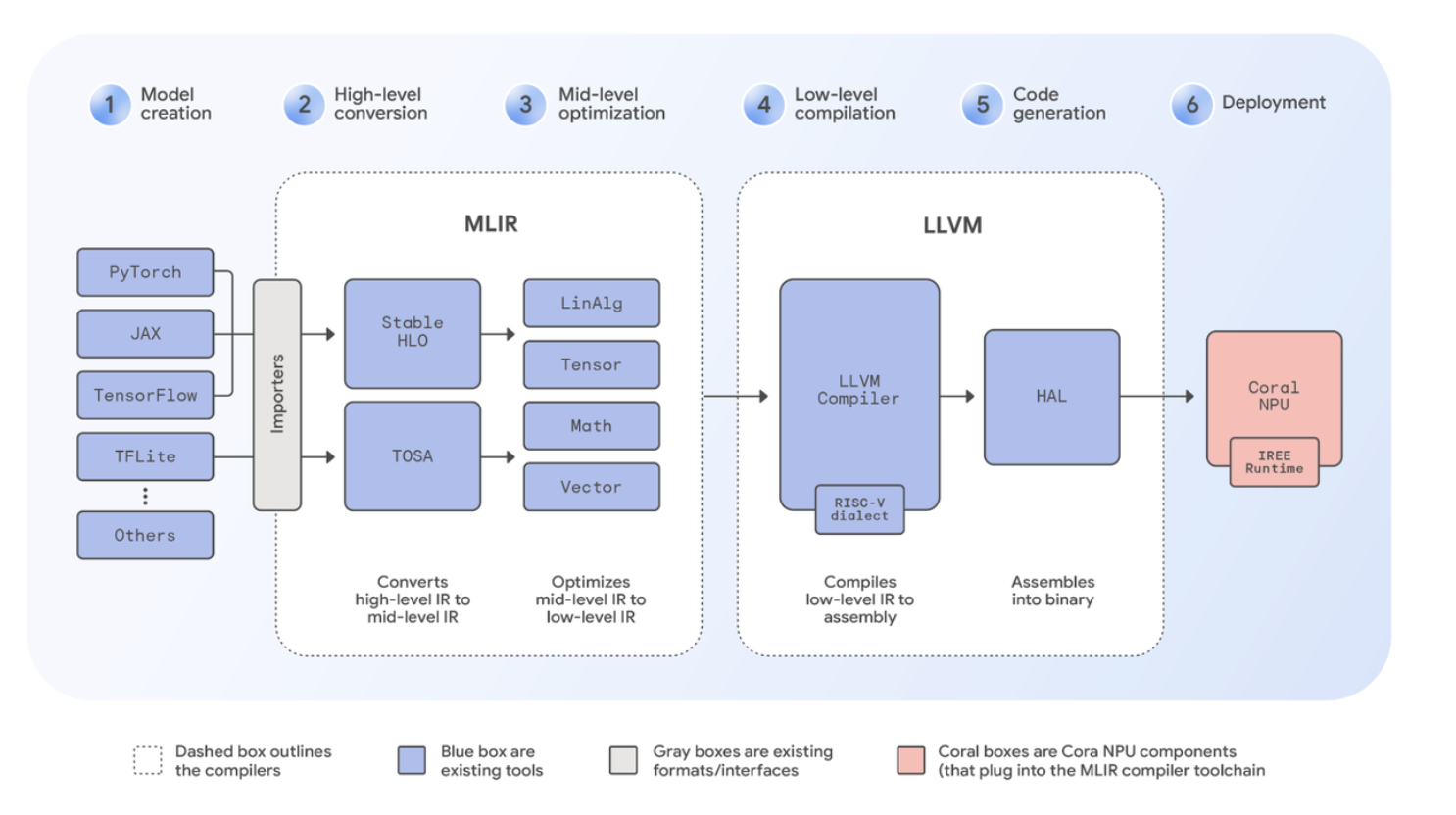

De plus, le soutien aux principes de l'open source accélère la croissance du marché et l'innovation. Synaptics collabore étroitement avec Google au développement de Coral, un cœur de traitement d'apprentissage automatique (machine learning, ML) RISC-V conçu pour les applications aux ressources limitées.

Synaptics et Google estiment que leur collaboration sur cette nouvelle technologie open source permettra aux développeurs IoT de créer plus facilement et à moindre coût de nouvelles applications basées sur l'apprentissage automatique, accélérant ainsi le développement de produits IoT basés sur l'IA, capables de traiter la vision, l'image, la voix, le son et d'autres modalités.

Aujourd’hui, la pression concurrentielle est énorme pour intégrer l'IA aux objets connectés afin de les rendre plus réactifs à un plus large éventail de commandes, telles que la reconnaissance vocale, gestuelle et faciale, ou d'ajouter des fonctionnalités et des capacités entièrement nouvelles.

Bien que l'IA ne soit pas une nouveauté, elle reste encore peu répandue et de nombreux défis se présentent aux non-initiés. La clé pour créer un produit compétitif réside dans le partenariat avec des experts qui maîtrisent les subtilités de l'IA, du traitement natif de l'IA, des logiciels, des modèles, et bien plus encore.

L'inférence IA est désormais pleinement envisageable pour n'importe quel produit en périphérie de réseau, y compris l'électronique grand public, les drones, des produits pour les maisons et les villes intelligentes, ainsi que les réseaux de capteurs pour tous types d'applications, de l'agriculture à l'industrie.

Pour les produits d'IA en périphérie de réseau, l'IA native n'est pas qu'une option. C'est la seule façon d'assurer une croissance durable. Les entreprises qui agissent dès maintenant seront celles qui assureront à long terme leur pérennité et leur pertinence sur leurs marchés.