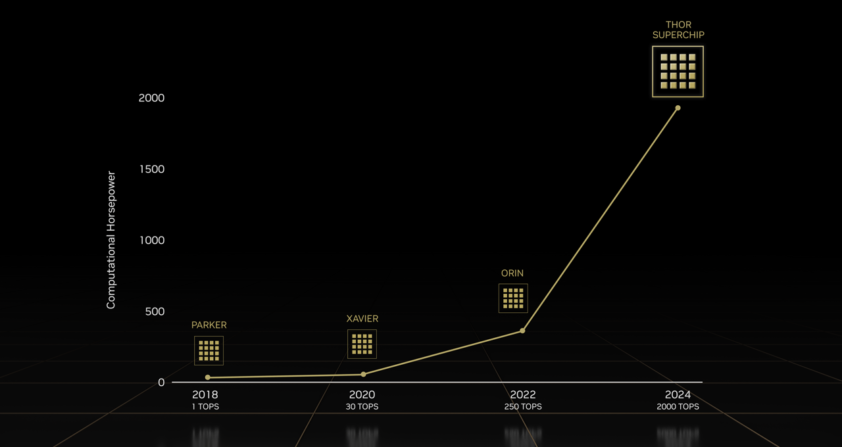

Bye-bye Drive Atlan, la plate-forme IA pour voitures autonomes de Nvidia annoncée en 2021 qui devait prendre la suite de son aînée Drive Orin, actuellement en production et apte à délivrer une performance de 254 Tops (téraopérations par seconde). Et bienvenue à Drive Thor !

Nvidia a profité de son événement annuel GTC pour lever le voile sur cette plate-forme qui remplace donc Drive Atlan et qui succèdera directement à Drive Orin. Capable d’offrir une puissance globale de 2 000 téraflops, elle sera en mesure, dixit Nvidia, d’unifier sur une seule architecture matérielle les fonctions intelligentes d’un véhicule, de la conduite assistée et automatisée à l’infodivertissement et au tableau de bord numérique, en passant par le stationnement automatique et la surveillance du conducteur et des passagers. Avec à la clé une plus grande efficacité et un coût global réduit par rapport aux approches distribuées, bâties sur plusieurs puces-systèmes distinctes, assure la société américaine.

Les constructeurs automobiles pourront toutefois configurer la plate-forme Drive Thor de diverses manières, en affectant par exemple toute sa puissance de calcul à la conduite autonome ou en en réservant une portion pour l’infodivertissement et les applications IA de l’habitacle, et une autre pour l’assistance au conducteur. Cette capacité « multidomaine » se double de mécanismes d’isolation permettant à des processus critiques de s’exécuter en parallèle sans interruption conformément aux exigences de sûreté de fonctionnement ISO 26262 Asil D, précise Nvidia.

Dans la pratique, la puce-système Thor, que l’on pourrait trouver dans des véhicules électriques de production dès le début 2025, notamment chez le constructeur chinois Zeekr, se déclinera autour d’un sous-système processeur Nvidia Grace (articulé autour de cœurs Armv9) et d’une unité graphique GPU Nvidia Hopper. On y trouvera également un moteur d’exécution de transformeurs, un nouvel élément des cœurs Tensor présents dans les GPU Nvidia. Les réseaux de transformeurs, qui sont des modèles d’apprentissage profond, peuvent traiter les flux de vision artificielle captés comme une unique trame de perception. Dotée d’un tel moteur, la plate-forme Drive Thor serait en mesure d’accélérer jusqu'à 9 fois les performances d'inférence de ce type de réseaux, une caractéristique essentielle pour l’exécution des charges de travail d'IA massives et complexes associées à la conduite automatisée.

La plate-forme afficherait un autre avantage non négligeable avec sa capacité de traitement à virgule flottante 8 bits (FP8) qui devrait s’imposer de plus en plus dans le monde de l’IA embarquée en raison d'un meilleur usage de la mémoire. En règle générale, les développeurs perdent la précision du réseau de neurones lors du passage des données du format FP 32 bits au format entier 8 bits. Du fait que la plate-forme Drive Thor offre une performance de 2 000 téraflops en précision FP8, les développeurs auront la possibilité de passer en 8 bits sans sacrifier la précision, indique Nvidia. A suivre donc.