Successeur du Q6 introduit l’année dernière par Cadence, le cœur de DSP Tensilica Vision Q7 multiplie par deux les performances des applications de vision et d’intelligence artificielle mises en œuvre sur les marchés de l’automobile, de la réalité augmentée/virtuelle, des communications mobiles et de la surveillance.... Conçu pour les fabricants de puces-systèmes SoC complexes, ce cœur de DSP de sixième génération est capable d’exécuter jusqu’à 1,82 Tops (téraopérations par seconde). Il est notamment optimisé pour les opérations de localisation et de cartographie simultanées (SLAM, Simultaneous Localization And Mapping), une technique couramment utilisée par les marchés de la robotique, des drones, de la téléphonie mobile et de l’automobile dont l’objet est de créer ou d’actualiser automatiquement des cartes d’un environnement inconnu. Une technique qui est aussi utilisée dans le domaine de la réalité virtuelle et de la réalité augmentée (AR/VR) pour les opérations de repérage dans l’espace (inside-out tracking).

Actuellement les applications en périphérie de réseau (edge) qui incluent une caméra d’imagerie doivent être équipées d’un DSP de vision capable d’effectuer des opérations de pré ou de post-traitement avant toute tâche d’intelligence artificielle. Lors de l’exécution d’opérations SLAM, les circuits SoC edge nécessitent également, selon Cadence, l’utilisation d’un moteur chargé de soulager les tâches de calcul pour augmenter les performances, réduire les temps de latence et minimiser la consommation des appareils alimentés par batterie. Dans la mesure où ces opérations SLAM utilisent des calculs en virgule fixe et en virgule flottante pour atteindre le niveau de précision nécessaire, tout DSP de vision utilisé pour les opérations de localisation et de cartographie simultanées doit, toujours selon Cadence, délivrer des performances supérieures pour les deux types de données.

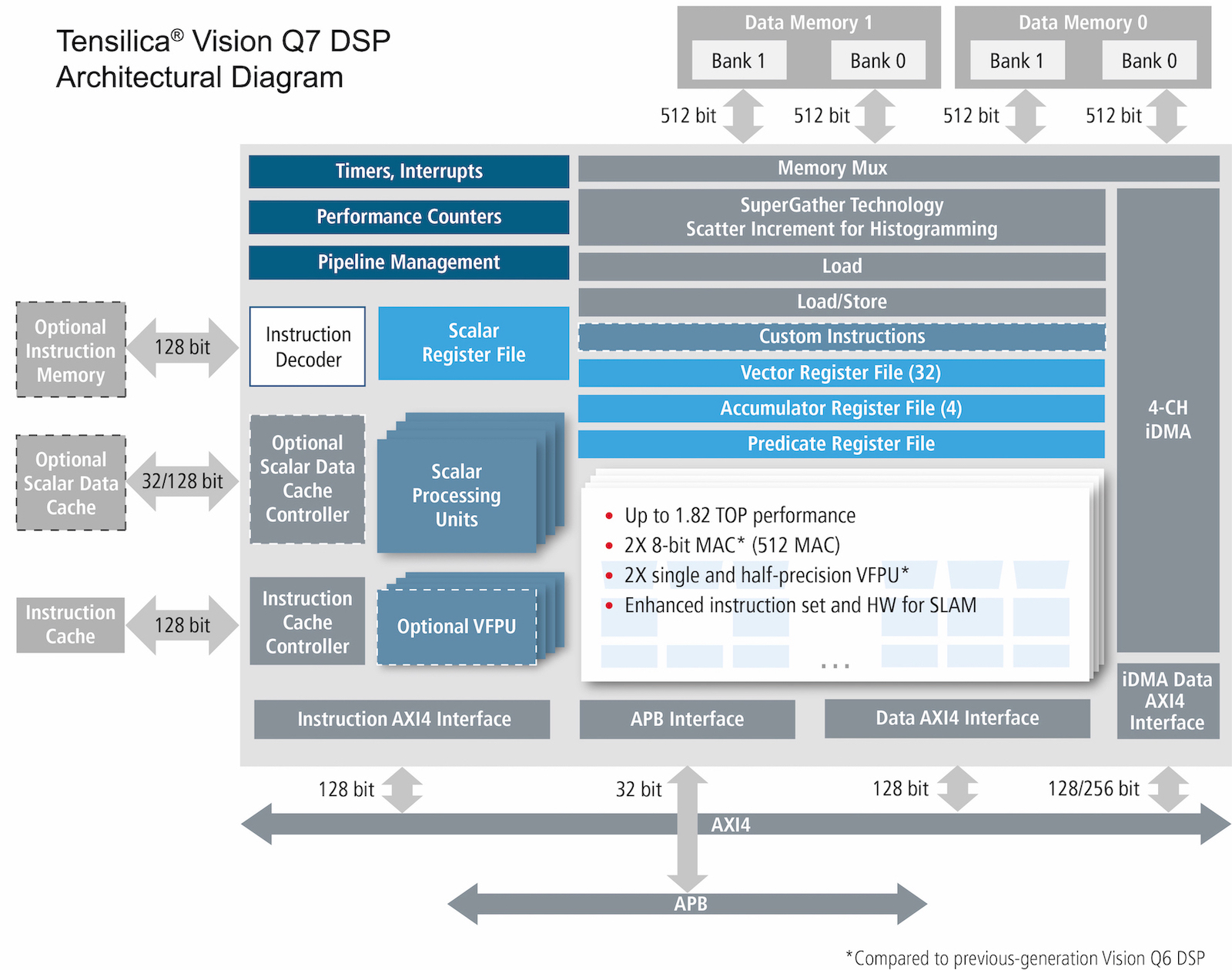

Pour y parvenir, d’un point de vue technologique, le Vision Q7 s’appuie sur une architecture dite SIMD (Single Instruction on Multiple Data) à mots d’instruction très longs VLIW (Very Long Instruction Words) qui permet d’exécuter jusqu’à 1,7 fois plus d’opérations Tops que le Vision Q6 dans un encombrement identique. Son jeu d’instructions enrichi prend en charge les données de 8/16/32 bits et assure, en option, l’exécution des opérations en virgule flottante vectorielle (VFPU) simple ou demi-précision avec des performances jusqu’à 2 fois plus élevées que les cœurs de processeurs précédents, Vision Q6 et Vision P6, sur des noyaux d’exécution de système SLAM.

Concernant les applications d’intelligence artificielle, le processeur Vision Q7 est capable d'effectuer jusqu’à 512 opérations MAC 8 bits, au lieu de 256 avec le Vision Q6, et peut être associé au processeur Tensilica DNA 100, un cœur de processeur qualifié par Cadence de premier processeur d’intelligence artificielle fondé sur une technologie d’accélérateur de réseaux de neurones profonds (DNA, Deep Neural-network Accelerator).

A noter que le DSP Vision Q7 est un surensemble du processeur Vision Q6, ce qui a pour effet de protéger les investissements logiciels déjà effectués sur cette version antérieure, et de faciliter la migration du Vision Q6 ou du Vision P6 vers le Vision Q7.

Côté logiciel, le Vision Q7 prend en charge les applications d’intelligence artificielle développées dans les environnements tels que Caffe, TensorFlow et TensorFlowLite grâce au compilateur de réseaux de neurones Tensilica Xtensa XNNC qui “mappe” les réseaux neuronaux dans un code exécutable optimisé pour le DSP Vision Q7. Ce processeur s'accommode également de l’API Android Neural Network (ANN) pour accélérer les applications d’intelligence artificielle aux sein de périphériques Android. Par ailleurs, l’environnement logiciel assure la prise en charge complète et optimisée de plus de 1 700 fonctions de vision de la bibliothèque graphique en open source OpenCV, initialement développée par Intel.

Enfin, tous les outils de développement et les bibliothèques sont conçus pour permettre aux fournisseurs de puces-systèmes d’obtenir la certification ISO 26262 jusqu’au niveau d’intégrité de sécurité automobile le plus élevé Asil D. Le processeur Vision Q7, qui a déjà été fourni à des utilisateurs stratégiques sous forme d’échantillons, devrait être disponible en production au cours du deuxième trimestre 2019.

Vous pouvez aussi suivre nos actualités sur la vitrine LinkedIN de L'Embarqué consacrée à l’intelligence artificielle dans l’embarqué : Embedded-IA https://www.linkedin.com/showcase/embedded-ia/