Acteur majeur de la CAO électronique et présent aussi sur le marché des blocs d’IP, et notamment sur celui des cœurs de processeur de vision artificielle, Synopsys a décidé de doper les performances du moteur d’exécution de réseaux de neurones à convolution (CNN) ...présent dans sa famille de processeurs DesignWare EV6x dévoilée en 2016. L’idée étant de répondre aux exigences de résolution vidéo et de vitesse d’affichage d’images requises par les applications de vision embarquée à hautes performances dans des domaines comme les systèmes d’aide évoluée à la conduite automobile (ADAS), la vidéosurveillance par drone, la réalité virtuelle ou augmentée, ou les applications de cartographie et de localisation simultanées (Slam, Simultaneous Localization and Mapping).

Dans le détail, le moteur CNN peut désormais délivrer, sous des conditions typiques, une puissance maximale de calcul de 4 500 giga-opérations MAC par seconde une fois implémenté avec des procédés de gravure FinFET 16 nm. Une valeur quatre fois supérieure au précédent moteur CNN utilisé par Synopsys. Le moteur CNN prend également en charge les opérations de compression/décompression des coefficients de connexion et des « feature maps » afin de réduire les besoins en bande passante et d’abaisser la consommation électrique.

Dans le détail, le moteur CNN peut désormais délivrer, sous des conditions typiques, une puissance maximale de calcul de 4 500 giga-opérations MAC par seconde une fois implémenté avec des procédés de gravure FinFET 16 nm. Une valeur quatre fois supérieure au précédent moteur CNN utilisé par Synopsys. Le moteur CNN prend également en charge les opérations de compression/décompression des coefficients de connexion et des « feature maps » afin de réduire les besoins en bande passante et d’abaisser la consommation électrique.

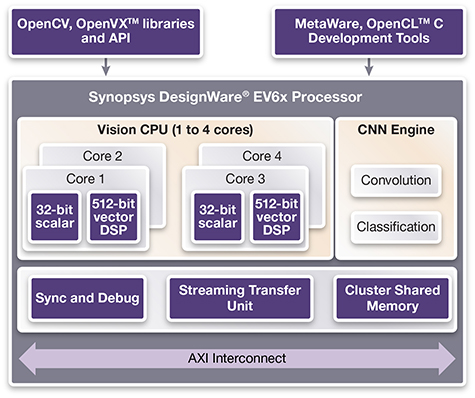

On rappellera que les processeurs EV61, EV62 et EV64 de Synopsys, dont la disponibilité est prévue courant août, intègrent également un, deux ou quatre cœurs dédiés à la vision. Le moteur CNN fonctionne en parallèle de ces cœurs sur les opérations de détection d’objets à haute précision, de classification d’image et de segmentation sémantique et ce pour une fraction de la consommation des solutions de vision concurrentes, précise Synopsys.

Dans le détail, chaque cœur de vision s’articule autour d’une unité de calcul scalaire 32 bits et d’un DSP pour calcul vectoriel de largeur 512 bits, le tout pouvant être configuré pour des opérations sur 8, 16 ou 32 bits. « L’association des DSP pour calcul vectoriel et du moteur CNN programmable au sein du processeur de vision DesignWare EV6x permet aux développeurs d’implémenter des fonctions de vision artificielle dans leurs systèmes embarqués avec une éco-efficacité bien meilleure que celle des alternatives à base de CPU ou de GPU », affirme Toshi Torihara, vice-président de la société Morpho US.

Les EV6x prennent en charge n’importe quel réseau de neurones à convolution (AlexNet, VGG16, GoogLeNet, Yolo, Faster R-CNN, SqueezeNet, ResNet…), le moteur CNN 12 bits pouvant exécuter des réseaux de neurones entraînés à l’origine pour des architectures 32 bits à virgule flottante, et ce avec une réduction significative de la consommation et de la taille des conceptions tout en maintenant les mêmes niveaux de précision de détection, assure Synopsys. En pratique, le moteur affiche une éco-efficacité de 2 000 GMAC/s/W lorsqu’il est implémenté en technologie de gravure FinFET 16 nm.

Côté outillage, la dernière version en date de la suite d’outils DesignWare ARC MetaWare EV inclut un outil de mappage CNN qui analyse les réseaux de neurones entraînés avec des environnements populaires comme Caffe et TensorFlow et génère automatiquement les exécutables pour le moteur CNN programmable. L’outil peut aussi distribuer les calculs entre le ou les cœurs de vision artificielle et les ressources CNN.