Créée en 2017 et basée à Zurich, la jeune pousse suisse aiCTX a développé un processeur d’intelligence artificielle neuromorphique totalement asynchrone et orienté événements, dont les caractéristiques, dixit son concepteur, le rendent adapté aux applications de vision temps réel à ultrabasse consommation toujours actives. ...

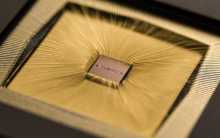

Fabriquée en technologie 22 nm et n’occupant qu’une surface de 12 mm2, la puce DynapCNN est censée ouvrir de nouvelles opportunités au traitement dynamique de la vision artificielle et mettre, pour la première fois, les applications de vision orientée événements à la portée des équipements portables alimentés sur piles ou batteries. Dans le détail, elle embarque plus d’un million de neurones impulsionnels et quatre millions de paramètres programmables au sein d’une architecture échelonnable optimisée pour l’implémentation de réseaux de neurones convolutifs (CNN), décrit aiCTX. Le circuit DynapCNN serait ainsi le premier Asic à associer la puissance de l’apprentissage automatique à l’efficacité du calcul neuromorphique orienté événements au sein d’une seule puce.

Selon la firme helvète, ce serait le moyen le plus direct et le plus éco-efficace de traiter des données générées par des capteurs de vision dynamique et orientés événements. De fait, les calculs au sein de la puce DynapCNN sont mis en œuvre directement lorsqu’apparaissent des variations dans la scène visualisée, sans recours à une horloge à haute fréquence. Les objets en mouvement génèrent des séquences d’événements qui sont traités immédiatement par le processeur. Comme il n’y a pas ici de notion d’images, les calculs en continu du circuit DynapCNN garantissent une latence ultrafaible, inférieure à 5 ms. Soit une amélioration d’un facteur au moins dix par rapport aux solutions actuelles d’apprentissage profond disponibles sur le marché de la vision artificielle en temps réel, assure aiCTX, et ce pour une éco-efficacité de 100 à 1 000 fois meilleure que l’état de l’art.

On se souviendra que c’est également une technologie totalement asynchrone qui est au cœur des capteurs de vision inspirés de l’œil humain de la société parisienne Prophesee (lire notre article ici). aiCTX compte commercialiser des kits de développement DynapCNN au cours du troisième trimestre 2019.

A noter que la société suisse, qui est un essaimage de l’Institut de neuro-informatique de l’université de Zurich et de l’Ecole polytechnique fédérale de Zurich (ETH Zürich), a d’ores et déjà procédé à deux levées de fonds, l’une en janvier 2018 (1,2 million de dollars) auprès du chinois PreAngel Capital, et l’autre en novembre 2018 (1,5 million de dollars) auprès de Baidu Ventures, le fonds d’investissement du groupe Baidu créé en 2017 et focalisé sur les start-up dotées d’un savoir-faire en intelligence artificielle.

-dissolve-basic-fr.jpg)