OpenFog Consortium. Tel est le nom de l’organisme industriel que viennent de mettre sur pied ARM, Cisco, Dell, Intel, Microsoft et l’université de Princeton avec, pour objectif avoué, la volonté d’accélérer le déploiement ...des technologies du « fog computing » au sein de l’Internet des objets.

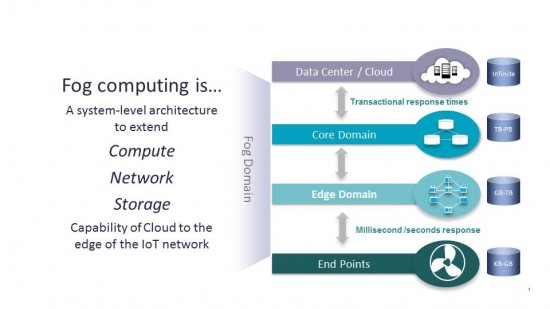

Le fog computing (ou informatique géodistribuée) vise à répartir les ressources de calcul, de communication, de contrôle/commande et de stockage au plus près des équipements et objets connectés (dans les passerelles placées en bordure de réseaux par exemple, voire dans les objets eux-mêmes), plutôt que de les concentrer sur des serveurs au cœur des infrastructures Internet, comme c’est le cas avec la traditionnelle informatique en nuage (cloud computing).

Dans ces conditions, les données émises par les capteurs IoT peuvent être traitées localement et des procédures de sécurité peuvent éventuellement être engagées immédiatement, un avantage loin d’être négligeable pour certaines industries critiques. Dans les secteurs de la production industrielle et des transports, le fog computing permet aussi aux applications de maintenance préventive de traiter des flux relativement importants de données au plus près des capteurs afin de générer des alertes avant même qu’un équipement ne tombe en panne. En grande distribution, les caméras positionnées sur les parkings, au-delà de la simple vidéosurveillance, peuvent aussi travailler main dans la main avec des logiciels d’analyse géodistribués afin de prédire le niveau d’affluence dans les rayons des supermarchés et d’optimiser le personnel en conséquence.

Dans les faits, l’OpenFog Consortium compte développer un framework architectural ouvert, instituer un forum de discussion sur les meilleures pratiques du fog computing, influencer les organismes de normalisation et mettre en place un banc d’essai à l’université de Princeton. L'organisme compte en ce sens relever un certain nombre de défis que pose l'informatique géodistribuée comme les délais de latence réseau, le support de noeuds d'extrémité mobiles, les goulets d'étranglement non prédictibles en termes de bande passante, la perte de connexion et la coordination distribuée des systèmes et des clients. Les premiers résultats concrets de l'OpenFog Consortium sont attendus début 2016.